OpenAI a commencé à tester des pubs dans ChatGPT aux États-Unis . En moins de deux mois, l'activité publicitaire a dépassé les 100 millions de dollars de revenus annualisés . L'entreprise vise 2,5 milliards de dollars de revenus publicitaires en 2026, et 100 milliards d'ici 2030 . Ces chiffres ne sont pas anecdotiques. Ils confirment ce que j'observe depuis des mois : le modèle économique des LLM gratuits ne tient pas debout sans subvention externe.

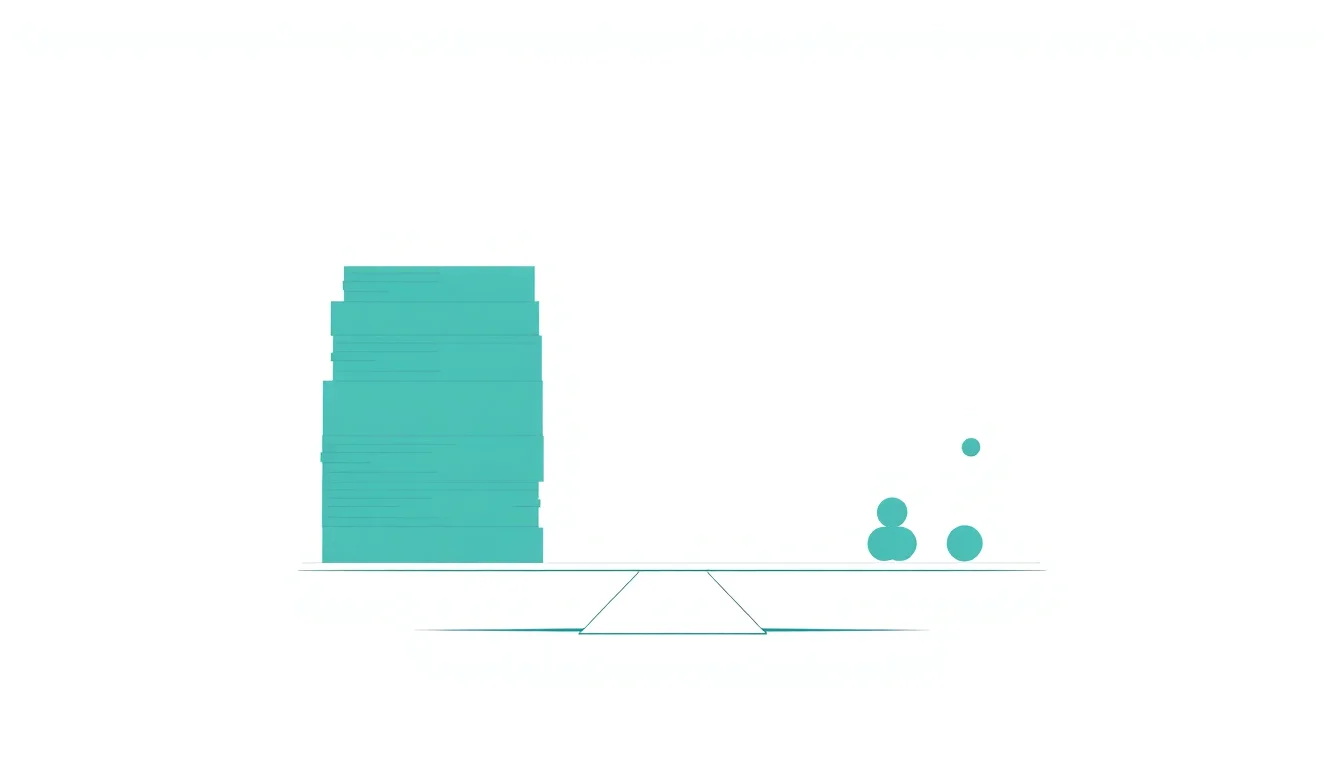

Le truc c'est que personne ne veut vraiment en parler. On préfère débattre sur "est-ce que la pub va biaiser les réponses ?" (non, probablement pas, mais bon). Le vrai sujet, c'est que OpenAI devrait perdre environ 14 milliards de dollars en 2026 sur les coûts de compute, recherche et infrastructure . Quatorze milliards. Garder un tier gratuit à l'échelle de ChatGPT sans pub, c'est juste indéfendable financièrement.

Le non-modèle économique du gratuit

ChatGPT est utilisé par des centaines de millions de personnes. Maintenir les tiers Free et Go rapides et fiables nécessite une infrastructure importante et un investissement continu. Les pubs aident à financer ce travail . OpenAI l'assume. Mais regardons ce qui se passe sous le capot.

Les coûts d'inférence des LLM ont chuté, c'est vrai. Les coûts d'inférence LLM ont baissé de 10 fois par an, plus vite que le compute PC ou la bande passante dotcom. La performance équivalente à GPT-4 coûte maintenant 0,40 dollar par million de tokens contre 20 dollars fin 2022 . Mais cette baisse ne suffit pas. Quand tu as 700 millions d'utilisateurs actifs et que la majorité utilise le tier gratuit, même un coût unitaire faible devient astronomique à l'échelle.

OpenAI ne s'attend pas à être rentable avant 2030 . Cette phrase résume tout. L'entreprise la plus visible de l'IA, valorisée à plus de 800 milliards, projette cinq ans de pertes. Et elle n'est pas seule : Anthropic, malgré un discours anti-pub militant, brûle aussi du cash. La différence, c'est qu'Anthropic a choisi de parier sur l'entreprise et les abonnements uniquement. On verra si ça tient.

La pub n'est pas une trahison, c'est un arbitrage

Anthropic a diffusé une campagne au Super Bowl centrée sur le slogan "Ads are coming to AI. But not to Claude." Les spots montraient des chatbots fictifs interrompant des conversations personnelles avec des pitchs sponsorisés. Altman a qualifié la campagne de "clairement malhonnête" , en disant qu'OpenAI ne montrerait jamais de pubs de cette façon-là. Il a raison sur un point : les pubs dans ChatGPT ne sont pas des pop-ups intrusifs. Les pubs apparaissent en bas des réponses, visuellement séparées de la réponse organique et clairement marquées comme sponsorisées .

Le format est cohérent. Mais Anthropic a aussi raison sur le fond : la pub change le rapport de confiance. Quand un outil devient une surface publicitaire, même séparée de la réponse, la question se pose : combien de temps avant que la frontière ne devienne floue ? OpenAI promet que les pubs n'influencent pas les réponses de ChatGPT et que les conversations restent privées vis-à-vis des annonceurs . Je le crois, pour l'instant. Mais l'histoire de l'internet nous a appris que les promesses initiales tiennent rarement quand la pression du revenu monte.

Franchement, l'alternative c'est quoi ? Faire payer tout le monde 20 dollars par mois ? Si tu préfères ne pas voir de pubs, tu peux passer aux plans Plus ou Pro, ou désactiver les pubs dans le tier Free en échange de moins de messages gratuits par jour . C'est un compromis clair. Et honnêtement, pour un dev solo comme moi qui a 10 euros près tous les mois, je préfère que la majorité des gens aient accès gratuitement avec de la pub plutôt qu'un paywall total.

Le vrai problème : les coûts de compute ne baissent pas assez vite

OpenAI a brûlé environ 8 milliards de dollars en cash en 2025. Les coûts de compute pour les modèles frontière ne baissent pas assez vite pour justifier un produit gratuit sans subvention. Les pubs sont le seul moyen réaliste de maintenir un tier gratuit à l'échelle où ChatGPT opère maintenant . C'est sec, mais c'est la réalité.

J'utilise Claude (Anthropic) quotidiennement via leur abonnement Max. Je ne vois pas de pub. Mais Anthropic n'a pas 700 millions d'utilisateurs, dont la majorité en gratuit. Leur modèle dépend entièrement de l'entreprise et des abonnements premium. Si demain leur croissance utilisateur explose et qu'ils gardent un tier gratuit généreux, ils auront le même problème qu'OpenAI. Leur pari, c'est que les revenus entreprise et développeur, plus les abonnements consommateurs, peuvent financer le modèle sans publicité consommateur . On verra. Mais Claude n'a pas de tier gratuit illimité comme ChatGPT Free historique. Le Free de Claude, c'est une poignée de messages par jour. C'est un autre arbitrage.

La vraie question ce n'est pas "pub ou pas pub". C'est : qui paie ? Soit l'utilisateur (abonnement), soit l'annonceur (pub), soit l'investisseur (levée de fonds infinie, ce qui est juste reporter le problème). OpenAI a choisi un mix des trois. Anthropic a choisi user + investisseur. Google et Meta peuvent se permettre de perdre de l'argent sur Gemini et Llama parce qu'ils ont des business publicitaires massifs ailleurs qui absorbent.

Ce qu'on rate dans le débat

Les gens s'énervent sur la pub dans ChatGPT. Je comprends. Mais personne ne parle du fait que les dirigeants ont dit aux investisseurs qu'OpenAI s'attend à générer plus de 17 milliards de dollars des consommateurs ChatGPT en 2026, avec la publicité représentant une part significative des revenus de la base utilisateurs gratuits . Si on fait le calcul : 17 milliards de revenus consommateurs totaux, dont 2,5 milliards de pub. Le reste, c'est les abonnements (Plus, Pro). Donc la pub, c'est environ 15% du revenu consommateur. C'est loin d'être marginal, mais c'est pas non plus le modèle principal.

Le vrai shift, c'est que ChatGPT montre encore des pubs à moins de 20% des utilisateurs éligibles, ce qui signifie que les 100 millions de dollars et l'accès self-serve ne sont que le début . Autrement dit : si ça marche, la surface publicitaire va s'étendre. Logique.

Pour les agents IA, c'est un autre niveau de complexité. Si demain les agents deviennent autonomes et prennent des décisions d'achat ou de recherche pour nous, la pub dans ces outils devient beaucoup plus glissante. Un agent qui recommande un produit sponsorisé au lieu du meilleur produit pour toi, c'est autre chose qu'une pub en bas d'une réponse à une question théorique. On n'y est pas encore, mais c'est le vrai risque.

L'équation des LLM gratuits ne tient que sur deux jambes

Soit tu as une autre source de revenus massive (Google, Meta), soit tu introduis de la pub, soit tu limites drastiquement le gratuit. Anthropic a choisi la troisième option : Claude Free existe, mais il est limité. OpenAI a choisi la deuxième : ChatGPT Free reste généreux, mais avec de la pub. Les deux sont cohérents.

Ce qui ne l'est pas, c'est de prétendre qu'on peut avoir des LLMs puissants, gratuits, illimités, sans pub, sans abonnement, à l'échelle de centaines de millions d'utilisateurs, et que c'est viable. C'est mathématiquement faux. Quelqu'un paie toujours. La question c'est qui, et avec quelles contreparties.

Pour l'instant, je garde mon abonnement Claude Max pour le dev intensif. Je continuerai à utiliser ChatGPT Free pour les trucs ponctuels, et je verrai des pubs. Tant qu'elles restent en bas des réponses et que je peux les dismiss, je m'en fous. Le jour où une pub biaise une réponse sur un sujet sensible (santé, finance, politique), là je me casserai. Mais pour l'instant, le format tient.

Et si la pub permet à des centaines de millions de gens d'avoir accès gratuitement à un outil qui coûte des milliards à faire tourner, c'est objectivement un deal correct. Juste, faut pas se raconter d'histoires : ce n'est pas de l'altruisme, c'est un modèle économique. Et c'est normal.

Questions fréquentes

Est-ce que les pubs vont influencer les réponses de ChatGPT ?

OpenAI affirme que les pubs n'influencent pas les réponses de ChatGPT. Les réponses sont optimisées en fonction de ce qui est le plus utile pour toi. Les pubs sont toujours clairement marquées comme sponsorisées et visuellement séparées . Pour l'instant, le format tient cette promesse. La vraie question, c'est si ça tiendra quand la pression du revenu augmentera.

Qui voit les pubs dans ChatGPT ?

Les pubs s'affichent pour les utilisateurs adultes connectés sur les tiers Free et Go. Les tiers Plus, Pro, Business, Enterprise et Education ne voient pas de pub . Si tu paies, tu n'as pas de pub. Si tu es gratuit, tu en as.

Pourquoi Anthropic ne met pas de pub dans Claude ?

Anthropic a annoncé publiquement que Claude ne portera pas de pubs. Ils ont même fait de la pub au Super Bowl pour se positionner en opposition à ChatGPT. Leur pari, c'est que les revenus entreprise, développeur et abonnements consommateurs peuvent financer le modèle sans publicité . C'est un choix de positionnement. Mais Claude Free est beaucoup plus limité que ChatGPT Free, ce qui rend la comparaison bancale.

Est-ce que les autres LLMs vont suivre avec de la pub ?

Google n'a actuellement pas de plans pour mettre des pubs dans Gemini, selon Demis Hassabis qui s'est dit "un peu surpris" qu'OpenAI ait bougé si tôt . Google peut se permettre d'attendre : Gemini sert aussi à améliorer Google Search, qui est déjà une machine publicitaire de 200 milliards par an. Pour les autres acteurs sans revenus alternatifs massifs, la pub arrivera tôt ou tard si le gratuit reste généreux.

Combien coûte la pub dans ChatGPT pour les annonceurs ?

OpenAI a lancé la pub en février avec un modèle CPM à 60 dollars pour mille impressions, qui a rapidement érodé vers 25 dollars en dix semaines. L'entreprise est passée à un modèle coût-par-clic avec des enchères entre 3 et 5 dollars . Le passage au CPC montre que le modèle initial était trop cher pour les annonceurs. C'est encore expérimental.